„The End of the Human Publisher?“ titelte vor kurzem etwas plakativ Flavorwire. Dem vermeintlichen Untergang des Abendlandes lag eine Meldung des Berliner Startups Inkitt zugrunde, die auf der Grundlage von Lesevorlieben ihrer Community einen Titel mit hohem Absatzpotential identifiziert hatten (auf der Plattform können Autoren ihre Texte einreichen, die dann von der Community gelesen werden können), der bei Tor Books, einer Tochter von Macmillan, nächstes Jahr in gedruckter Form erscheinen soll. Data Driven Publishing also, wie es der buchreport betitelte.

„The End of the Human Publisher?“ titelte vor kurzem etwas plakativ Flavorwire. Dem vermeintlichen Untergang des Abendlandes lag eine Meldung des Berliner Startups Inkitt zugrunde, die auf der Grundlage von Lesevorlieben ihrer Community einen Titel mit hohem Absatzpotential identifiziert hatten (auf der Plattform können Autoren ihre Texte einreichen, die dann von der Community gelesen werden können), der bei Tor Books, einer Tochter von Macmillan, nächstes Jahr in gedruckter Form erscheinen soll. Data Driven Publishing also, wie es der buchreport betitelte.

Daraufhin ging ein Grummeln durch die Branche, so etwa ein Hamburger Verleger: „Das hat die Welt gebraucht: Bücher, die mit einem ähnlichen Verfahren kompiliert werden, wie der Facebook-Newsfeed. Spannend! Innovativ! Bullcrap!“

Hier liegen schlicht Missverständnisse darüber vor, was Maschinenlogik für den Verlagsbetrieb bedeutet – Grund genug, einmal die Hintergründe genauer zu beleuchten. Im Kern geht es nämlich um auf Datenanalyse beruhende Programmplanung.

Auch wenn die Berichterstattung um Inkitt sehr missverständlich war: es geht im Prinzip nur darum, aufgrund einer Zielgruppenanalyse ein passendes Produkt, eine passende Produktform zu generieren. Das ist seit Bestehen der Branche täglich Brot des Verlegers: ein Produkt (idR gedruckt) für eine bestimmte Zielgruppe zu machen, und zwar auf einer wirtschaftlich möglichst ertragreichen Basis.

Auch die viel gerühmte „Überraschungs-Literatur“ mit dem Impetus, den Leser mit etwas zu überraschen, das er eigentlich im ersten Moment gar nicht gesucht hat, unterliegt diesem Prozess. Auch hier kann man jemand nur überraschen wenn man möglichst viel von ihm weiß. Und es darf auch nicht vergessen werden, dass die Diskussion um ach so böse Algorithmen gerne stimmgewaltig von Verlegern autorengetriebener Belletristik geführt wird. Tatsächlich stehen diese nur für einen Bruchteil der Verlagsbranche – Diskussionen um analysegestützte Programmplanung werden mit einem Fachbuch- oder gar Fachzeitschriftenverleger anders oder gar nicht geführt.

„Predictive data analysis is the way of the future” sagt folgerichtig Ali Albazaz, Inkitts Gründer und CEO, und er meint damit eine mit heutigen technologischen softwaregestützen Mitteln mögliche Sammlung an Markt- und Kundenwissen, die in dieser Form in der Vergangenheit nicht möglich war. Man mag dies „Big Data“ oder „Small Data“ nennen, am Ende ist es entscheidend, die relevanten Daten für Management- oder Produktentwicklungsprozesse zur Verfügung zu haben. Welche Inhalte für welche Zielgruppe in welcher Produktform in welchen Quantitäten? Diese Fragen müssen valide beantwortbar sein.

Gleichzeitig kommt ein weiterer Punkt zum Tragen: relevante Daten müssen schnell zur Verfügung stehen. Nicht, weil Software-Analysesysteme dies können – sondern weil Märkte, Zielgruppen, Leser heute viel fragmentierter, viel schneller, auch „sprunghafter“ in ihren Lese- und Kaufentscheidungen sind. Und, genauso wichtig: die angeschlossenen Prozesse müssen ähnlich schnell sein. Das auf der Basis der Zahlen von Inkitt ermittelte „optimale“ Buch wird gedruckt erscheinen – irgendwann 2017. Ob der Leser von heute ein Jahr auf sein Wunschprodukt warten will? Eher unwahrscheinlich. Und schlimmer: Was, wenn ein Mitbewerber mit schlankeren Prozessen ein adäquates Produkt nicht 2017, sondern noch in diesem Sommer veröffentlicht?

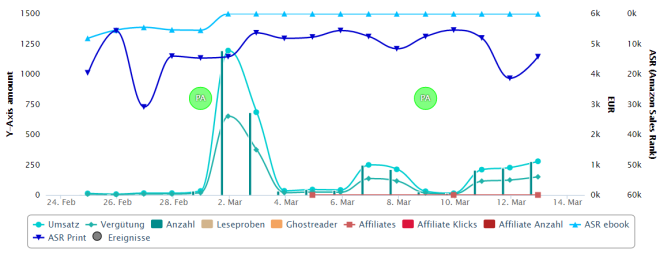

Aus diesem Grund beschäftigt sich readbox seit Jahren mit Themen wie „Data Analytics“, „Business Intelligence“ und vielem mehr. Ziel ist es, unseren Kunden ein Set an wirklich relevanten Daten für eben jene oben erwähnten Management-Prozesse an die Hand zu geben, um die richtigen Entscheidungen heute treffen zu können – und nicht die falschen morgen. Sprechen Sie uns an!

Jetzt teilen oder weitersagen:

Gefällt mir Wird geladen …

Ohne Metadaten – also diejenigen Daten, die ein Produkt wie zum Beispiel ein Buch beschreiben – würde sich überhaupt kein Produkt verkaufen lassen. Kunden kaufen und Anbieter vermarkten inzwischen zunehmend unpersönlich. Gleichzeitig individualisiert sich die Konsumgesellschaft. Optimierte und kontinuierlich gepflegte Metadaten bedeuten, dass mein Produkt überhaupt gesehen, als relevant erkannt und gekauft werden kann. Jedes denkbare Produkt ist heute nur einen Klick entfernt. Deshalb werden Wettbewerbsvorteile inzwischen auf Metadatenebene erzielt: Entscheidend ist nicht mehr so sehr die Beziehung zum Händler. Entscheidend ist, dass meine Produkte genau dort, wo der Konsument seinen Bedarf formuliert …

Ohne Metadaten – also diejenigen Daten, die ein Produkt wie zum Beispiel ein Buch beschreiben – würde sich überhaupt kein Produkt verkaufen lassen. Kunden kaufen und Anbieter vermarkten inzwischen zunehmend unpersönlich. Gleichzeitig individualisiert sich die Konsumgesellschaft. Optimierte und kontinuierlich gepflegte Metadaten bedeuten, dass mein Produkt überhaupt gesehen, als relevant erkannt und gekauft werden kann. Jedes denkbare Produkt ist heute nur einen Klick entfernt. Deshalb werden Wettbewerbsvorteile inzwischen auf Metadatenebene erzielt: Entscheidend ist nicht mehr so sehr die Beziehung zum Händler. Entscheidend ist, dass meine Produkte genau dort, wo der Konsument seinen Bedarf formuliert … „The End of the Human Publisher?“ titelte vor kurzem etwas plakativ

„The End of the Human Publisher?“ titelte vor kurzem etwas plakativ